Gemini führt mit Lyria 3 die KI-basierte Musikproduktion ein

Google hat die Gemini-App um eine KI-gestützte Musikkompositionsfunktion erweitert. Die Funktion nutzt Lyria 3, das neueste generative Musikmodell von Google DeepMind, und wird derzeit in der Beta-Phase eingeführt.

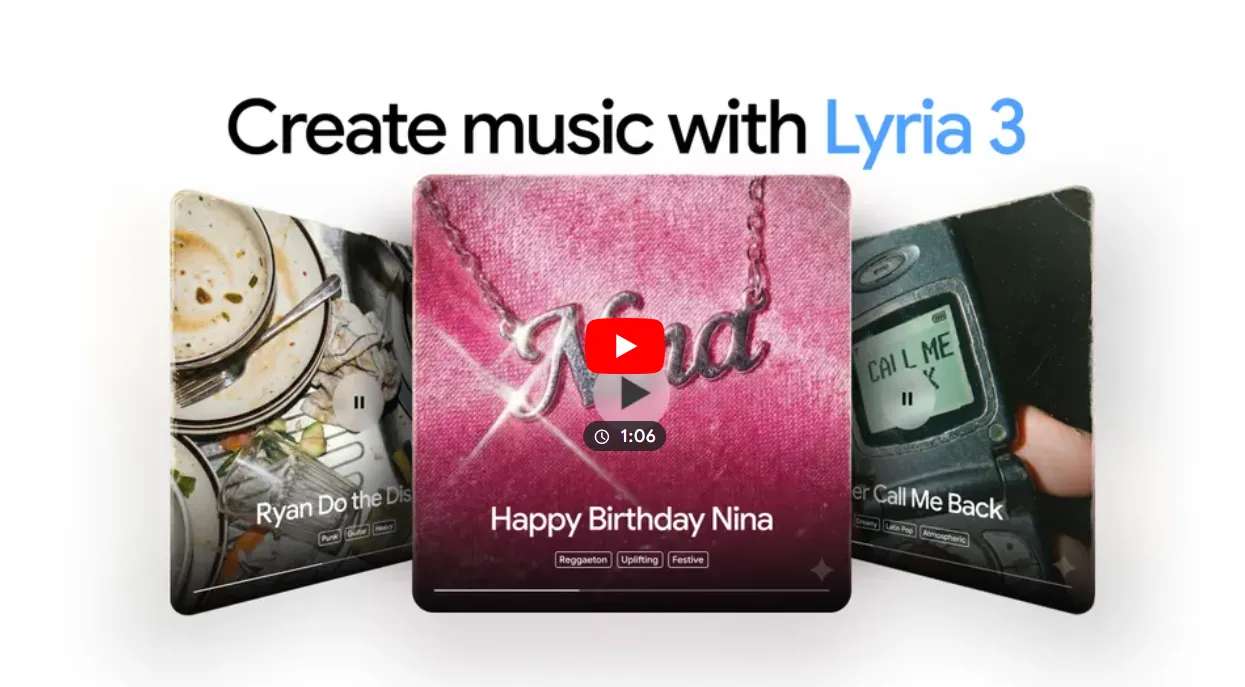

Google hat die kreativen Möglichkeiten seiner Gemini-App mit der Beta-Einführung von Lyria 3 erweitert, seinem fortschrittlichsten generativen Musikmodell, das von Google DeepMind entwickelt wurde. Mit der neuen Funktion können Nutzer 30-sekündige Musiktitel anhand einfacher Textvorgaben oder sogar Bildern und Videos erstellen. Dies ist der nächste Schritt des Unternehmens im Bereich der KI-gestützten kreativen Ausdrucksmöglichkeiten.

Google DeepMind erweitert erneut die Grenzen der generativen KI. Diesmal liegt der Fokus nicht auf Text oder Bildern, sondern auf Musik. Das Google-Team hat kürzlich Lyria 3 vorgestellt, sein bislang fortschrittlichstes Modell zur Musikgenerierung. Lyria 3 stellt eine bedeutende Veränderung in der Art und Weise dar, wie Maschinen komplexe Audio-Wellenformen und kreative Absichten verarbeiten.

Mit der Veröffentlichung von Lyria 3 in der Gemini-App bringt Google diese Tools aus dem Forschungslabor in die Hände der alltäglichen Nutzer. Wenn Sie Softwareentwickler oder Datenwissenschaftler sind, finden Sie hier alles, was Sie über die technische Landschaft von Lyria 3 wissen müssen.

Die Herausforderung der KI-Musik

Die Erstellung eines Musikmodells ist viel schwieriger als die Erstellung eines Textmodells. Text ist diskret und linear. Musik ist kontinuierlich und vielschichtig. Ein Modell muss Melodie, Harmonie, Rhythmus und Klangfarbe gleichzeitig verarbeiten. Außerdem muss es eine langfristige Kohärenz gewährleisten. Das bedeutet, dass ein Song von der ersten bis zur 30. Sekunde wie derselbe Song klingen muss.

Lyria 3 wurde entwickelt, um diese Probleme zu lösen. Es erzeugt High-Fidelity-Audio, das Gesang und Multi-Instrumental-Tracks umfasst. Es fügt nicht einfach nur Loops zusammen, sondern generiert komplette Musikarrangements von Grund auf neu.

Lyria 3 und die Gemini-Integration

Lyria 3 ist jetzt in der Gemini-App verfügbar. Benutzer können eine Eingabeaufforderung eingeben oder sogar ein Bild hochladen, um einen 30-sekündigen Musiktitel zu erhalten. Interessant ist, wie Google dies in ein multimodales Ökosystem integriert.

In der Gemini-App ermöglicht Lyria 3 einen schnellen „Prompt-to-Audio”-Workflow. Sie können eine Stimmung, ein Genre oder eine bestimmte Instrumentengruppe beschreiben. Das Modell gibt dann eine hochwertige Datei aus. Diese Integration zeigt, dass Google Audio neben Text und Bild als primäre Modalität behandelt.

Echtzeitsteuerung: Lyria RealTime

Die Lyria RealTime API ist der Ort, an dem die eigentliche Innovation stattfindet. Im Gegensatz zu herkömmlichen Modellen, die wie eine „Jukebox” funktionieren (Eingabe einer Eingabeaufforderung und Warten auf eine Datei), arbeitet Lyria RealTime mit einem chunkbasierten Autoregressionssystem.

Es nutzt eine bidirektionale WebSocket-Verbindung, um einen Live-Stream aufrechtzuerhalten. Das Modell generiert Audio in 2-Sekunden-Blöcken. Es greift auf den vorherigen Kontext zurück, um den „Groove” beizubehalten, während es gleichzeitig die Benutzersteuerung berücksichtigt, um den Stil zu bestimmen. Auf diese Weise kann das Audio mithilfe von WeightedPrompts gesteuert werden.

Kommentare (0)

Kommentar verfassen

Noch keine Kommentare vorhanden. Seien Sie der Erste, der kommentiert!